爬虫使用代理 (爬虫使用代理的作用)

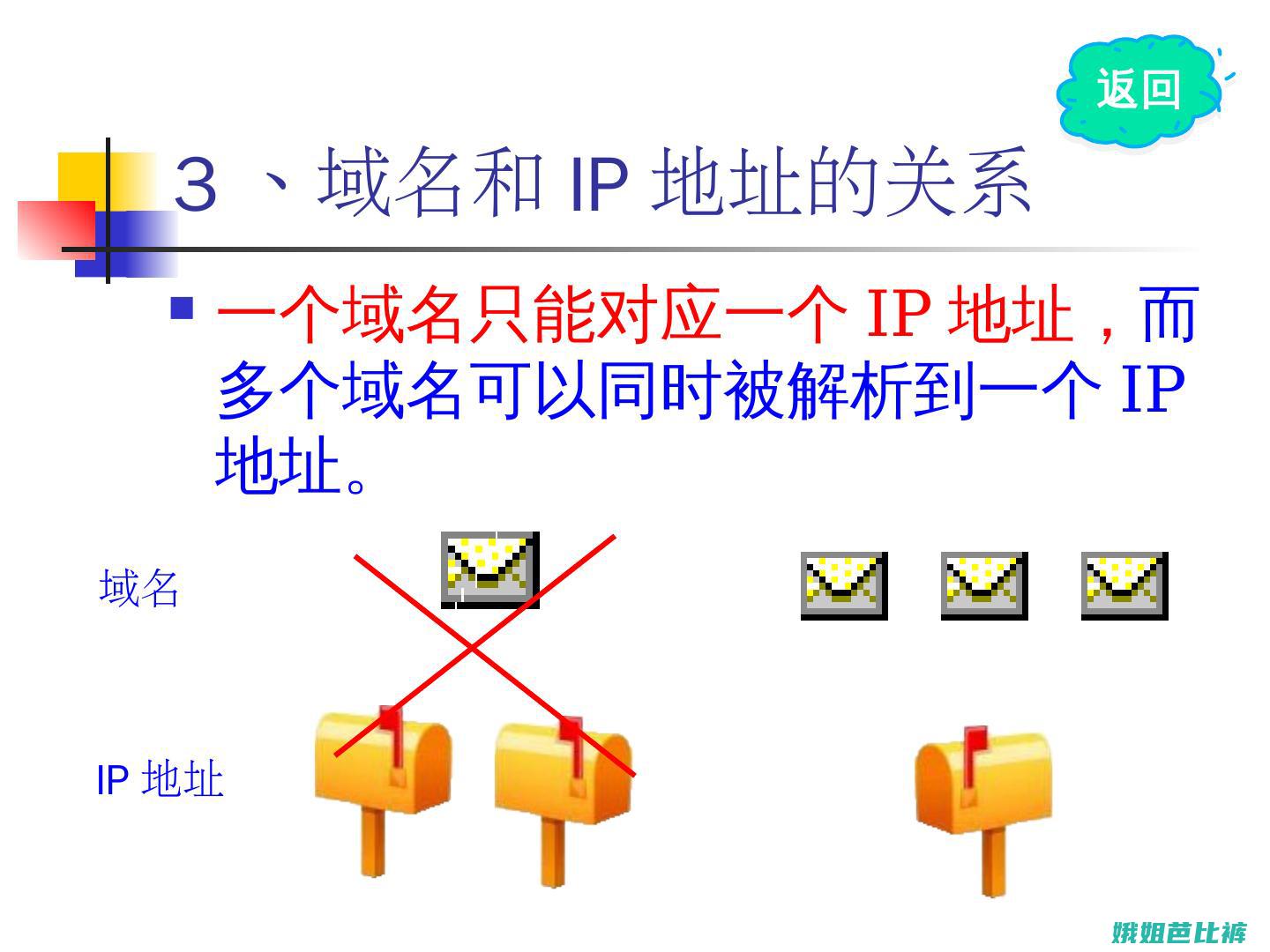

爬虫使用代理是一种常用的技术手段,用于在进行网络数据抓取时隐藏爬虫的真实IP地址,防止被目标网站识别出爬虫行为,从而避免IP被封锁或限制。代理服务器本质上是位于中间的网络服务器,充当客户端和目标服务器之间的中转节点,向目标服务器转发请求并将响应返回给客户端,起到隐藏客户端真实IP地址的作用。爬虫使用代理的作用主要体现在以下几个方面:

1. 隐藏真实IP地址

爬虫在访问网站时,如果频繁使用相同的IP地址进行请求,容易被目标网站识别出爬虫行为并采取相应措施,如封禁IP地址、设置验证码验证等。通过使用代理,可以实现在一段时间内使用不同的IP地址,使目标网站难以追踪和识别爬虫的真实IP地址,从而降低被封禁的风险。

2. 提高访问速度

有些网站对同一个IP地址的访问进行了限制,如限制每个IP地址的请求频率、并发连接数等。通过使用代理,可以将请求分发到多个代理IP上,实现并发请求,提高爬取数据的速度和效。同时,代理服务器可能位于不同地域或国家,选择合适的代理IP能够更快地获取目标网站的数据。

3. 解决地域限制

有些网针对特定地域的IP地址进行访问控制,如Netflix、BBC等视频网站对于地域限制较为严格。通过使用代理,可以将爬虫的请求经过代理服务器,获取目标网站返回的数据后传输给爬虫,从而绕过地域限制,实现跨地域数据抓取。

4. 改善反爬虫策略

一些网站为了防止爬虫行为,会采种反爬虫策略,如检测请求头、设置Cookie验证、设置验证码等。通过使用代理,可以在一定程度上绕过这些反爬虫策略,以代理服务器的IP地址进行请求,降低被识别为爬虫的可能性,提高爬取数据的成功率。

5. 保护隐私安全

在进行网络数据抓取时,保护个人隐私安全尤为重要。通过使用代理,可以隐藏爬虫的真实IP地址,降低个人信息泄漏的风险。同时,合理选择代理服务器也能够保护爬虫的安全,避免遭受网络攻击或恶意追踪。

爬虫使用代理不仅可以有效隐藏爬虫的真实IP地址,提高访问速度和效率,解决地域限制,改善反爬虫策略,还能保护个人隐私安全。在进行网络数据抓取时,合理使用代理一种重要的技术手段,有助于提升爬虫的稳定性和成功率。

初学Domino,想知道代理的用处,和具体的小例子

可以理解为一个事先写好的Function,在需要的时候调用,可以执行一些后台操作或者返回一些数据。 当然还可以设置为定时运行。 例如在页面打开的时候可以通过调用代理加载当前用户的信息。

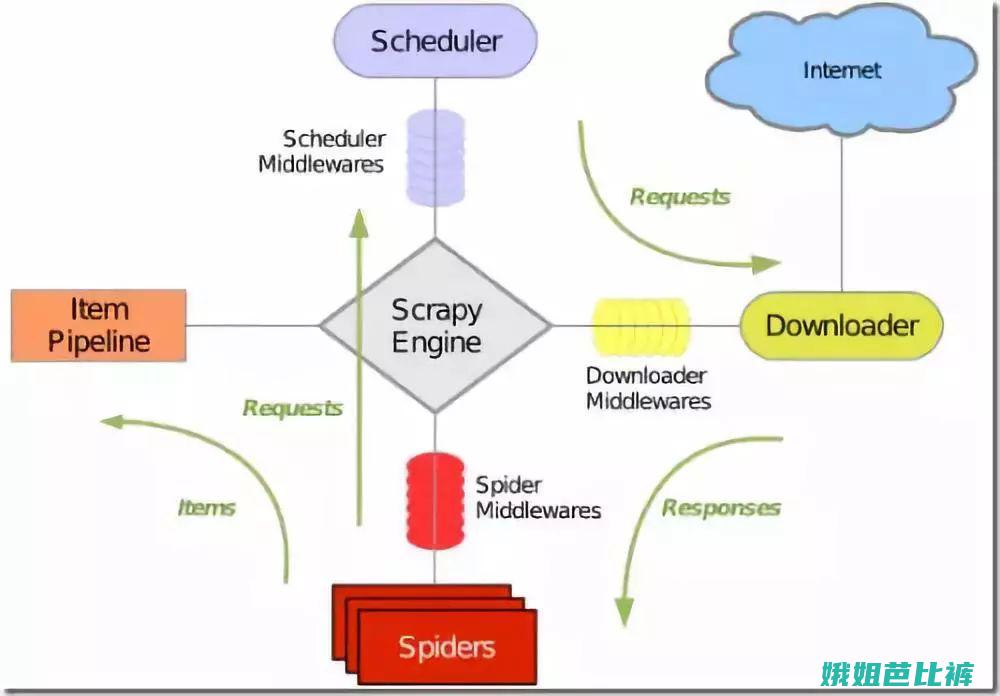

使用爬虫的目的是什么

是为了从网页中抓取数据,并转换成结构化的形式。

什么是代理?它的作用是什么?

SQL Server Agent代理服务,是sql server的一个标准服务,作用是代理执行所有sql的自动化任务,以及数据库事务性复制等无人值守任务。 这个服务在默认安装情况...

相关标签: 爬虫使用代理、 爬虫使用代理的作用、

本文地址:http://www.29bbk.com/article/1075.html

<a href="http://www.29bbk.com/" target="_blank">娥姐芭比裤</a>

人气排行榜

人气排行榜